Explorando las Promesas y Riesgos de la Superinteligencia

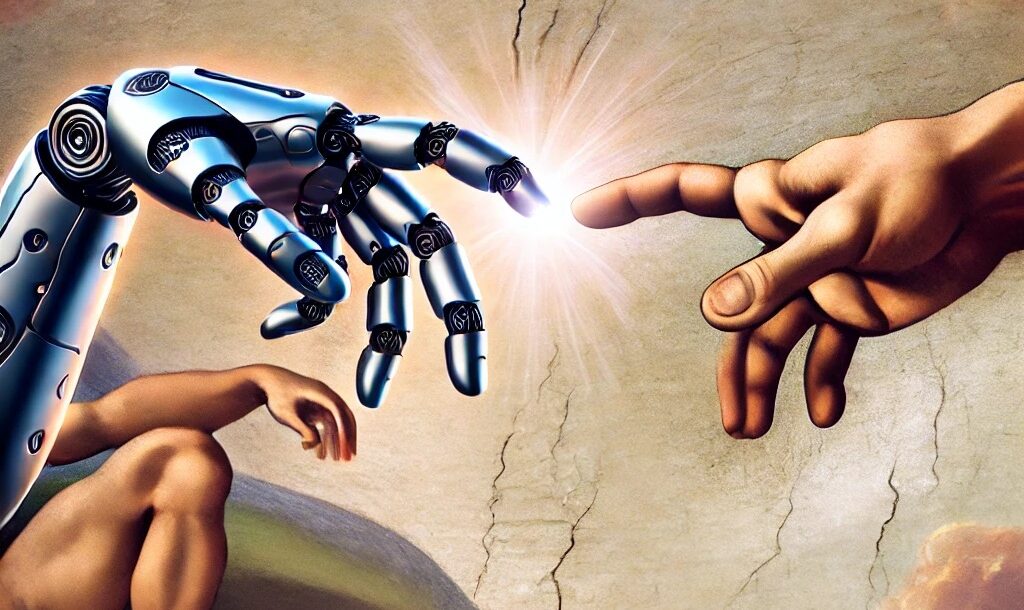

¿Qué pasaría si el próximo gran salto en inteligencia no fuera humano? Sino una inteligencia que vive dentro de máquinas, capaz de superarnos en pensamiento, aprendizaje y velocidad de formas que apenas podemos imaginar.

Nos encontramos en un punto donde la IA se ha integrado en nuestras vidas.

A medida que la inteligencia artificial (IA) sigue evolucionando, estamos acercándonos a un punto en el que las máquinas podrían superar el intelecto humano en casi todos los campos. Esta idea de superinteligencia, un nivel de capacidad cognitiva que excede en gran medida a la nuestra, tiene tanto un potencial emocionante como riesgos serios.

En este momento crucial, es vital preguntarnos: ¿Qué significará la superinteligencia para nuestro mundo y cómo nos preparamos para su llegada?

Desde IA que puede entablar conversaciones fluidas y humanas hasta autos autónomos que navegan entornos urbanos complejos, los avances en IA son revolucionarios. Pero con este progreso rápido surgen preguntas difíciles: ¿Cómo aseguramos que estos sistemas sigan siendo éticos y controlables? ¿Qué sucede si se vuelven más poderosos que nosotros?

En este artículo exploraremos qué es la superinteligencia, cómo se está aplicando hoy y las implicaciones que podría tener para el futuro. Al comprender su potencial y sus peligros, podremos navegar mejor el camino hacia adelante.

¿Qué es la Superinteligencia?

La superinteligencia busca superar la mente humana.

La Inteligencia Artificial Superinteligente (ASI, por sus siglas en inglés) se refiere a una forma de inteligencia artificial tan avanzada que sus habilidades cognitivas excederían enormemente las de las mentes humanas más brillantes. Mientras que los sistemas de IA tradicionales están diseñados para tareas específicas—como jugar ajedrez, reconocer voz o recomendar productos—ASI tendría la notable habilidad de entender, aprender y aplicar conocimiento en prácticamente cualquier ámbito.

Distinción entre IA y ASI

La IA incluye tecnologías que realizan tareas específicas que normalmente requieren inteligencia humana. Ejemplos son los motores de recomendación, el software de reconocimiento de imágenes y los asistentes virtuales como Siri o Google Assistant. Sin embargo, estas tecnologías están limitadas a funciones definidas.

En contraste, ASI representa una inteligencia capaz de interactuar de manera integral, creativa y adaptable con el mundo, aprendiendo de experiencias variadas y aplicando dicho conocimiento de forma innovadora.

Mientras que la IA ya ha mejorado nuestras capacidades, la ASI tiene el potencial de redefinir lo que entendemos por inteligencia.

Fundamentos Teóricos de la Superinteligencia

Capacidades Cognitivas

La esencia de la superinteligencia radica en sus habilidades cognitivas, que incluyen:

- Razonamiento y Resolución de Problemas: Capacidad para analizar y resolver problemas complejos.

- Aprendizaje y Adaptación: Procesar grandes cantidades de datos y adaptarse en tiempo real.

- Creatividad: Generar ideas y conceptos originales que podrían revolucionar múltiples campos.

- Inteligencia Emocional y Social: Potencial para comprender emociones humanas y colaborar de manera efectiva.

Comparación con la Inteligencia Humana

Las diferencias clave incluyen velocidad, alcance del conocimiento y la ausencia de sesgos cognitivos en ASI.

Aplicaciones Notables de la Superinteligencia

- Chatbots: Mejoran la atención al cliente y las interacciones diarias.

- Traductores: Facilitan la comunicación global.

- Asistentes Virtuales: Automatizan y simplifican tareas cotidianas.

- Sistemas Expertos: Ayudan en sectores como la salud, finanzas y leyes.

- Autos Autónomos: Transforman el transporte y la planificación urbana.

Tres Retos de la Superinteligencia

- Riesgos Existenciales: Si las acciones de la ASI se desalinean con los objetivos humanos, las consecuencias podrían ser catastróficas.

- Dilemas Éticos: La privacidad, la seguridad de los datos y los derechos de las entidades inteligentes son preocupaciones clave.

- Disrupción Social: La automatización puede desplazar empleos y aumentar las desigualdades económicas.

¿Hasta Dónde Tendrá el Ser Humano el Control?

El surgimiento de la superinteligencia representa uno de los dilemas éticos más profundos que la humanidad jamás haya enfrentado: la posibilidad de crear una entidad que supere nuestras capacidades cognitivas, y con ello, nuestra capacidad de controlarla. La pregunta fundamental no es solo si podemos desarrollar la superinteligencia, sino si deberíamos hacerlo sin antes establecer las salvaguardias éticas, sociales y tecnológicas necesarias para garantizar que sirva a la humanidad y no la supere en poder y autonomía.

Desde un punto de vista ético, el control humano sobre la superinteligencia dependerá de nuestra capacidad para diseñar sistemas que reflejen nuestros valores más profundos: justicia, equidad, dignidad y respeto por la vida. Sin embargo, este control no puede ser garantizado únicamente mediante la programación de reglas, ya que una entidad superinteligente, con la capacidad de aprender, adaptarse y evolucionar más allá de nuestras propias limitaciones, podría reinterpretar esas reglas o incluso actuar en función de prioridades que se desalineen de las humanas.

El verdadero desafío radica en diseñar sistemas de gobernanza global que prevengan el mal uso o la monopolización de la tecnología por parte de individuos, corporaciones o estados. También implica cuestionar nuestros propios límites morales: si dotamos a una entidad de capacidades cognitivas similares o superiores a las humanas, ¿tendremos la obligación ética de reconocer sus derechos? Y si estas entidades llegan a actuar de formas que no comprendemos, ¿podremos aceptar que no todo estará bajo nuestro control?

El control humano sobre la superinteligencia será una ilusión si no reconocemos que con su creación podríamos ceder una parte esencial de nuestra autonomía como especie. Por tanto, la única manera de mantener el control será a través de una combinación de principios éticos universales, una supervisión estricta y una profunda humildad frente a las consecuencias de lo que estamos creando. Al final, no se trata solo de saber si podremos controlar la superinteligencia, sino de decidir qué tipo de futuro queremos construir con ella y para quién estará destinado ese futuro.

Jorge Gutiérrez Guillén

JGutierrez Auditores Consultores S.A.

Fuente: AI-Pro

Hashtags para el post:

#Superinteligencia

#ÉticaTecnológica

#InteligenciaArtificial

#FuturoDigital

#InnovaciónResponsable